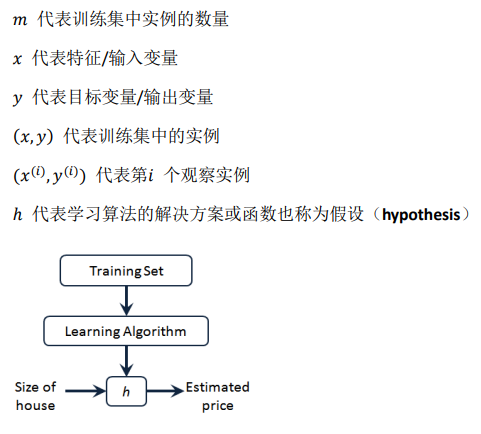

模型表示

- 单变量线性回归模型:ℎ𝜃(𝑥) = 𝜃0 + 𝜃1𝑥

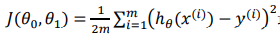

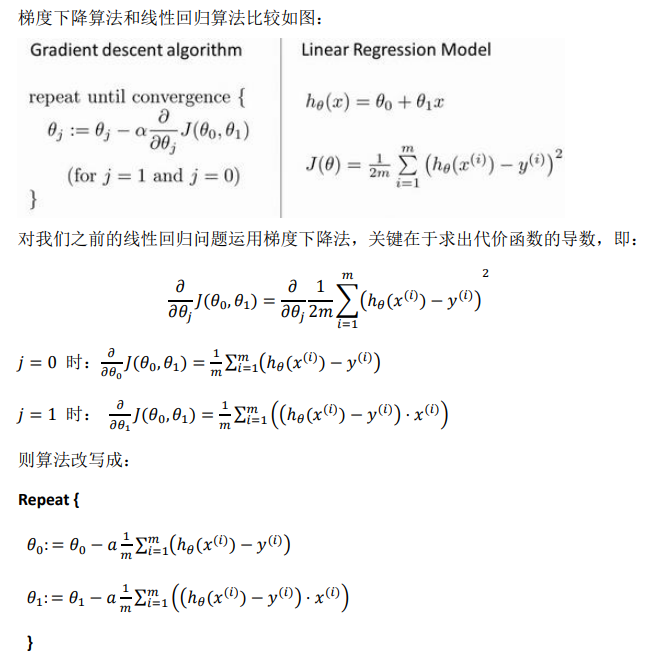

代价函数

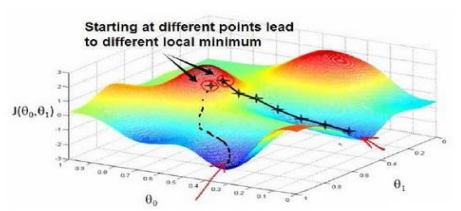

梯度下降

定义:一种求函数最小值的算法,可以用这个方法求代价函数

思想:

随机选择一个参数的组合(𝜃0, 𝜃1, . . . . . . , 𝜃𝑛 )

计算代价函数𝐽(𝜃0, 𝜃1)

寻找下一个能让代价函数值下降最多的参数组合(更新参数)

持续直到一个局部最小值or全局最小值

Tips:选择不同的初始参数组 合,可能会找到不同的局部最小值

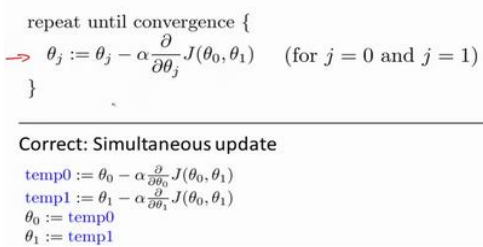

更新规则

Tips:a.同时更新更新𝜃0和𝜃1,因为参数变动会影响𝐽(𝜃0, 𝜃1)值

b.为啥求导?因为沿着负梯度方向代价函数值下降最多(链接用泰勒公式证明了)。

c. 𝑎是学习率,决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大

学习率a大小影响

a.太小:需要很多步才能到达最低点,太慢,需要很多步。

b.太大:会导致无法收敛,甚至发散。

批量梯度下降

Tips:批量梯度下降指:在梯度下降的每一步中,我们都用到了所有的训练样本。